Heutzutage ist die Grenze zwischen ganz normalen Smart-Geräten für uns alle und hochspezialisierten medizinischen Hilfsmitteln fast vollständig verschwunden. Dieses Phänomen, das bei Technik-Nerds oft “Hidden Tech” (versteckte Technologie) genannt wird, bezeichnet die zahlreichen fortschrittlichen Software- und Hardware-Features in unseren Alltagsgeräten, die das Leben von Menschen mit Behinderungen enorm verbessern.

Automatische Worterkennung oder Sprachsteuerung spart dem Durchschnittsnutzer Sekunden. Doch für Menschen mit schweren motorischen Einschränkungen, etwa bei Zerebralparese, sind diese Funktionen oft die einzige Brücke zu einem unabhängigen Leben und zur digitalen Kommunikation. Über 6 Milliarden Menschen weltweit besitzen ein Smartphone – diese Geräte sind heimlich zur meistverbreiteten, günstigsten und zugänglichsten assistiven Technologie der Geschichte geworden. Statt sperrige Apparate mitzuschleppen, nutzen Menschen heute die Rechenleistung in ihren Hosentaschen.

APPLE-ÖKOSYSTEM: RÄUMLICHES BEWUSSTSEIN, BERÜHRUNGSLOSE STEUERUNG UND TAKTILE MUSIK

Apple setzt bei der Barrierefreiheit auf ein geschlossenes System aus eigenen Chips und abgestimmter Software. Die Daten werden direkt auf dem Gerät verarbeitet (On-Device Processing). Dadurch werden Verzögerungen in wichtigen Momenten vermieden und es ist sichergestellt, dass sensible Gesundheitsdaten und biometrische Informationen das iPhone nicht verlassen.

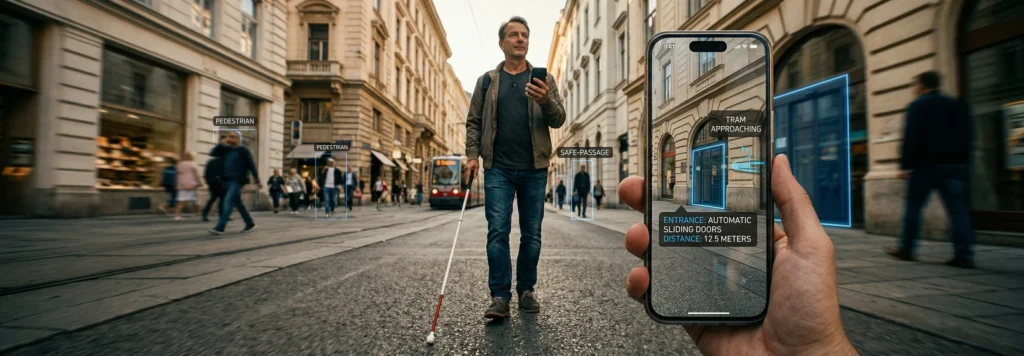

Das wohl faszinierendste Beispiel dafür ist der LiDAR-Scanner in den Pro-Modellen von iPhone und iPad. Mit der App Lupe (Magnifier) wird die Kamera dank Laserimpulsen quasi zu einem 3D-Radar. Die Türerkennung (Door Detection) löst ein riesiges Problem für blinde Menschen: die Navigation auf den letzten Metern”. Das System berechnet die genaue Entfernung zur Tür, liest Schilder per optische Erkennung vor und sagt dir, ob du die Tür drücken oder ziehen musst.

Für Menschen mit Lähmungen hat Apple die Augensteuerung (Eye-Tracking-Technologie) eingebaut. Du brauchst keine tausend-Euro-externen Sensoren mehr – das iPhone nutzt einfach die Frontkamera und maschinelles Lernen, um die Mikrobewegungen deiner Pupillen zu tracken. Du schiebst den virtuellen Cursor nur mit deinem Blick über den Screen. Wenn du dich auf einen Punkt konzentrierst, simulierst du einen Fingertipp und behältst so die volle Kontrolle über deine Apps. Um Leuten mit atypischer Sprache zu helfen, gibt es jetzt Vocal Shortcuts (Sprachkurzbefehle). Damit kannst du eigene Laute oder Phrasen festlegen, die das iPhone als komplexe Systembefehle erkennt.

Eine weitere versteckte Superkraft der Apple-Hardware ist die Taptic Engine, ein genialer Vibrationsmotor. Mit Music Haptics hat Apple es ermöglicht, dass gehörlose und schwerhörige Menschen Musik richtig “fühlen” können. Das System übersetzt Rhythmus, Bass und Gesang in Echtzeit in spürbare Impulse. So wird Musikhören auf dem Handy zu einem völlig neuen, multisensorischen Erlebnis.

“iks.haus / KI-generiert mit DALL-E 3”

IDENTITÄT BEWAHREN: PERSONAL VOICE UND TIEFE NEURONALE NETZE

Wenn man die Fähigkeit verliert, zu sprechen, etwa durch Krankheiten wie ALS oder OP, ist das ein krasser Verlust an Autonomie. Man verliert nicht nur das Mittel zur Kommunikation, sondern auch einen Teil seiner Identität, der in der eigenen Stimme steckt. Apples Antwort darauf heißt „Personal Voice“ (eigene Stimme).

Du musst nur für knapp 15 Minuten zufällig generierte Sätze vorlesen. Das System nutzt dann komplexe tiefe neuronale Netze, analysiert deine Sprachmuster und erstellt einen einzigartigen künstlichen Klon deiner Stimme, der deine Intonation genau wiedergibt. Dieser Klon wird nahtlos in die die Live Speech (Live-Sprachausgabe) eingebunden. Du tippst einfach, was du sagen willst, und dein iPhone oder Mac spricht es bei Telefonaten, FaceTime oder im direkten Gespräch mit deiner eigenen “lebendigen” Stimme aus.

GOOGLE UND ANDROID: MULTIMODALE KI, PROJECT ASTRA UND DIE AUDIO-REVOLUTION

Im Gegensatz zu Apples geschlossenem System, bei dem Hard- und Software perfekt zusammenspielen und Daten direkt auf dem Gerät verarbeitet werden, setzt Google auf die enorme Rechenleistung der Cloud und bringt Open-Source-KI weltweit auf Android-Geräte.

Der Screenreader TalkBack hat durch die direkte Integration des Gemini Nano-Modells ein massives Upgrade erhalten. Statt dir nur zu sagen “Foto von einem Hund”, liefert TalkBack blinden Menschen jetzt extrem detaillierte, multimodale Fotobeschreibungen. Es erkennt, aus welchem Stoff Klamotten bestehen, welche Emotionen Leute auf Fotos zeigen und wie Gebäude aufgebaut sind – und das alles komplett offline zum Schutz der Privatsphäre.

In der echten Welt geht Google mit Project Astra noch weiter. Zusammen mit dem Dolmetscherdienst Aira entwickelt, nutzt diese KI die Handykamera oder eine smarte Brille, um die Umgebung in Echtzeit in einem Videostream zu checken. Anders als bei Fotos kann Astra einer blinden Person in Echtzeit sagen, wo genau ein gesuchter Gegenstand liegt, warnt vor Hindernissen auf dem Weg und führt intelligente Konversationen über die Umgebung. Gleichzeitig übernimmt Guided Frame (Geführter Rahmen) die Rolle des Fotografen und hilft blinden Menschen, ihre Gesichter mithilfe von Audio-Tipps und Vibrationen perfekt für ein Selfie oder ein Gruppenfoto zu positionieren.

Der vielleicht krasseste technologische Durchbruch ist, mit Project Relate gelungen zu sein. Diese App wurde speziell für Menschen mit Dysarthrie und schwer verständlicher Sprache entwickelt, etwa nach einem Schlaganfall oder bei Muskeldystrophie. Colin Hughes, ein ehemaliger BBC-Produzent mit Muskeldystrophie, der eine Atemmaske trägt, erzählte, dass ihm normale Diktiergeräte nutzlos wurden. Aber nachdem Project Relate auf seine spezifische Stimme trainiert worden war, konnte es das Surren seines Beatmungsgeräts einfach ignorieren und seine Worte nahezu perfekt in sauberen Text übersetzen.

Auch die Android-Betriebssysteme wachsen zunehmend mit medizinischen Hilfsmitteln zusammen. Android 16 und 17 brachten krasse Verbesserungen für LE Audio (Low Energy Audio). Gehörlose und schwerhörige Menschen können jetzt Systemtöne direkt von ihrem Handy auf ihre Hörgeräte übertragen. Noch cooler: Mit Android 16 kannst du dein Smartphone als externes Richtmikrofon nutzen. Du richtest es im lauten Restaurant einfach auf die Person, mit der du sprichst, und das Handy sendet die klare Stimme kabellos an dein Hörgerät, während der gesamte Hintergrundlärm rausgefiltert wird.

“iks.haus / KI-generiert mit DALL-E 3”

ZUBEHÖR DAS LEBEN RETTET: KNOCHENSCHALL-KOPFHÖRER

Weil blinde Nutzer vollständig auf die Sprachansagen ihres Handys angewiesen sind, besteht auf der Straße ein Sicherheitsproblem. Wenn du klassische Kopfhörer trägst, die den Gehörgang vollständig dicht machen, kann das lebensgefährlich sein, wenn du dich beim Überqueren der Straße auf dein Gehör verlassen musst.

Die Lösung stammt ursprünglich aus dem Militär: kabellose Knochenschallkopfhörer (Bone Conduction Headphones). Sie haben einen leichten Rahmen und sitzen vor dem Ohr, genau auf dem Wangenknochen. Der Ton wird durch Mikrovibrationen direkt ins Innenohr übertragen. Das Trommelfell wird vollständig umgangen, und der Gehörgang bleibt frei. So kann eine blinde Person die GPS-Ansagen vom Handy super klar hören, kriegt aber trotzdem alle Autos, die Anweisungen ihres Blindenhundes und das Klicken ihres Blindenstocks perfekt mit.

EU-GESETZE UND DIE HARTE REALITÄT “KLEINER” SPRACHEN

Während diese Silicon-Valley-Innovationen nach Science Fiction klingen, geht die Schere bei den Nutzern weltweit immer weiter auseinander. Der Wechsel zu riesigen Sprachmodellen (LLMs) hat die digitale Sprachbarriere massiv vergrößert. Leute, die “große” Sprachen wie Englisch oder Spanisch sprechen, bekommen futuristische Tools in die Hand gedrückt, während Nutzer in Märkten wie dem kroatischen Sprachraum in die Röhre schauen.

Apples Personal Voice, die unheilbar Kranken ihre Stimme zurückgibt, gibt es auf Kroatisch schlichtweg nicht. Das Gleiche gilt für Googles Project Relate, das atypische Sprache genial versteht, offiziell aber immer noch hauptsächlich auf englischsprachige Länder beschränkt ist. Nutzer in diesen Ländern bleiben von lebensverändernden Tech-Hilfen abgeschnitten, nur weil den Tech-Riesen der finanzielle Anreiz fehlt, sich um die lokalen Sprachen zu kümmern.

Ein großer Lichtblick ist jedoch der rechtliche Druck durch den European Accessibility Act (EAA), dessen strenge Regeln ab dem 28. Juni 2025 in ganz Europa gelten. Dieses Gesetz zwingt private Unternehmen und den öffentlichen Sektor in der gesamten EU in die Pflicht. Alle digitalen Produkte – egal ob Smartphones, Online-Shops, Geldautomaten oder ÖPNV-Apps – müssen dann hohe Standards für Barrierefreiheit (basierend auf WCAG und EN 301 549) erfüllen. Wer sich nicht daran hält, riskiert fette Strafen oder fliegt vom europäischen Markt.

Der EAA sendet eine klare Message: KI und versteckte Tools in Smartphones sind keine Ausrede für schlampiges, nicht-inklusives App-Design. Auch wenn moderne KI Fotos problemlos scannen und beschreiben kann, sind Firmen gesetzlich immer noch verpflichtet, echte Alt-Texte und eine saubere, barrierefreie Architektur manuell einzubauen. Die perfekte “versteckte Technologie” darf die Verantwortung niemals auf den Nutzer mit Behinderung abwälzen. Sie soll einfach ein unsichtbarer Helfer sein, der die Fehler unserer Gesellschaft ausgleicht und jedem das Recht auf ein unabhängiges und würdevolles Leben garantiert.